“Cha đẻ của HBM” dự báo kỷ nguyên AI lấy bộ nhớ làm trung tâm, HBF có thể thay đổi vai trò GPU

Trong bối cảnh các công ty công nghệ đẩy mạnh phát triển hạ tầng phục vụ AI, một xu hướng mới đang dần hình thành: chuyển dịch từ kiến trúc lấy GPU làm trung tâm sang kiến trúc lấy bộ nhớ làm lõi. Nhận định này đến từ Giáo sư Joungho Kim (KAIST), người được xem là “cha đẻ của HBM”.

Theo ông, mô hình AI hiện tại, vốn phụ thuộc mạnh vào GPU và được dẫn dắt bởi NVIDIA, sẽ không còn duy trì vị thế thống trị trong dài hạn. Thay vào đó, bộ nhớ sẽ trở thành yếu tố quyết định hiệu năng và cấu trúc hệ thống AI trong tương lai.

AI agentic đẩy bộ nhớ thành “nút thắt cổ chai”

Sự chuyển dịch này bắt nguồn từ thay đổi trong chính bản chất của AI. Khi các mô hình tiến hóa từ generative sang agentic, khối lượng dữ liệu cần xử lý tăng vọt. Khái niệm “context engineering” xuất hiện, mô tả việc AI phải xử lý đồng thời lượng lớn tài liệu, video và dữ liệu đa phương thức.

Điều này khiến bộ nhớ trở thành điểm nghẽn lớn nhất. Theo dự báo, cả băng thông và dung lượng bộ nhớ cần tăng tới 1.000× để đảm bảo tốc độ và độ chính xác. Thậm chí, nếu quy mô dữ liệu đầu vào tăng 100–1.000×, nhu cầu bộ nhớ có thể tăng theo cấp số nhân, lên tới 1 triệu lần.

HBM dần chạm ngưỡng, HBF nổi lên như hướng đi mới

Hiện nay, HBM (High Bandwidth Memory) là công nghệ chủ đạo trong các bộ tăng tốc AI, nhờ khả năng xếp chồng DRAM theo chiều dọc để đạt tốc độ truyền dữ liệu cực cao. Tuy nhiên, theo Giáo sư Kim, HBM sẽ dần bộc lộ giới hạn trong kỷ nguyên AI agentic.

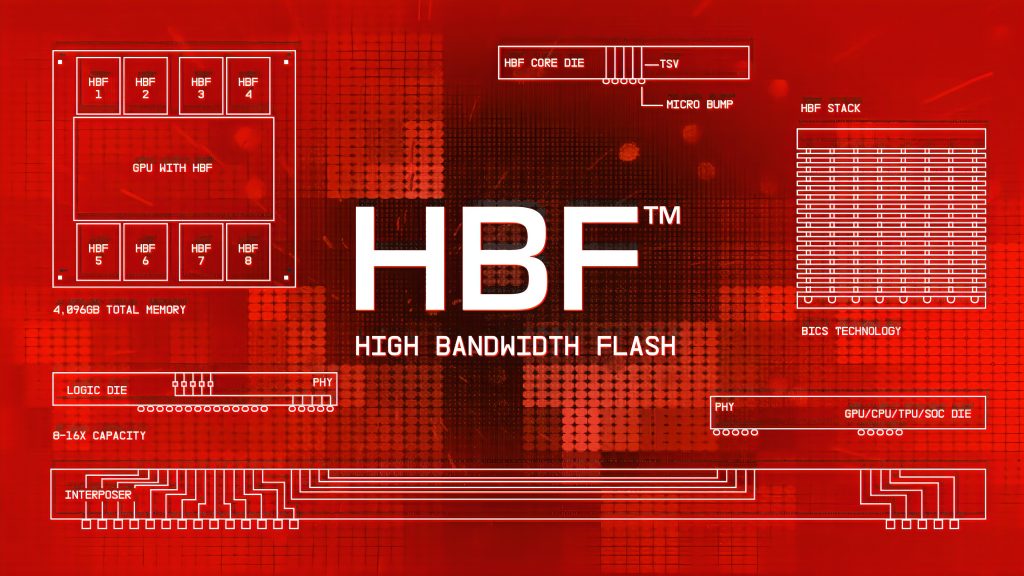

Giải pháp thay thế được nhắc tới là HBF (High Bandwidth Flash). Công nghệ này sử dụng NAND xếp chồng thay cho DRAM, cho phép mở rộng dung lượng bộ nhớ lên mức rất lớn, tương tự một “thư viện dữ liệu” khổng lồ dành cho AI.

Điểm khác biệt cốt lõi nằm ở khả năng lưu trữ dài hạn với quy mô vượt trội, giúp AI xử lý các tác vụ phức tạp mà không bị giới hạn bởi dung lượng như hiện nay.

Kiến trúc AI tương lai: bộ nhớ là trung tâm, xử lý nằm bên trong

Không chỉ dừng lại ở công nghệ, sự thay đổi còn diễn ra ở cấp độ kiến trúc. Giáo sư Kim cho rằng trong tương lai, hệ thống AI sẽ được xây dựng xoay quanh các khối bộ nhớ dung lượng cực lớn như HBM và HBF, thay vì xoay quanh GPU hay CPU.

Điều này đồng nghĩa với việc bộ xử lý có thể được “nhúng” trực tiếp vào trong cấu trúc bộ nhớ, thay vì bộ nhớ chỉ đóng vai trò hỗ trợ như hiện nay.

Một ví dụ cụ thể cho xu hướng này đến từ SK hynix. Trong một nghiên cứu trình bày tại IEEE, hãng đã giới thiệu kiến trúc “H3”, trong đó HBM và HBF được triển khai song song bên cạnh GPU.

So với thiết kế hiện tại, nơi chỉ có HBM nằm gần bộ xử lý, mô hình này mở ra cách tiếp cận hoàn toàn mới cho chip AI.

HBF có thể xuất hiện từ 2027, các “ông lớn” đã nhập cuộc

Theo dự báo, các mẫu thử nghiệm HBF có thể xuất hiện vào khoảng năm 2027. Những tên tuổi lớn như Google, AMD hay NVIDIA được kỳ vọng sẽ sớm ứng dụng công nghệ này từ năm 2028.

Cuộc đua HBF cũng được dự báo sẽ tái hiện kịch bản cạnh tranh khốc liệt của HBM, với hai đối thủ quen thuộc là Samsung Electronics và SK hynix.

Thực tế, SK hynix đã bắt đầu hợp tác với SanDisk để thành lập liên minh tiêu chuẩn hóa HBF, nhằm chiếm lợi thế hệ sinh thái từ sớm. Trong khi đó, Samsung vẫn tiếp tục phát triển các thế hệ HBM mới như HBM4E bên cạnh HBM3, đồng thời đầu tư vào kiến trúc NAND phù hợp với xu hướng HBF.

Sự trỗi dậy của HBF và xu hướng “memory-centric AI” cho thấy một bước chuyển lớn trong ngành bán dẫn và AI. Khi dữ liệu ngày càng phình to và mô hình AI ngày càng phức tạp, bộ nhớ không còn là thành phần phụ trợ mà đang trở thành trung tâm của toàn bộ hệ thống.

Nếu dự báo này trở thành hiện thực, vai trò của GPU sẽ không biến mất, nhưng chắc chắn sẽ được định nghĩa lại trong một kiến trúc hoàn toàn mới.

Chia sẻ bài viết

Bình luận

( 0 bình luận )Bình luận của bạn

Tin tức liên quan

-baa990c76bc65.jpg)