Khi agentic AI thay đổi cuộc chơi: CPU quay lại trung tâm hạ tầng AI

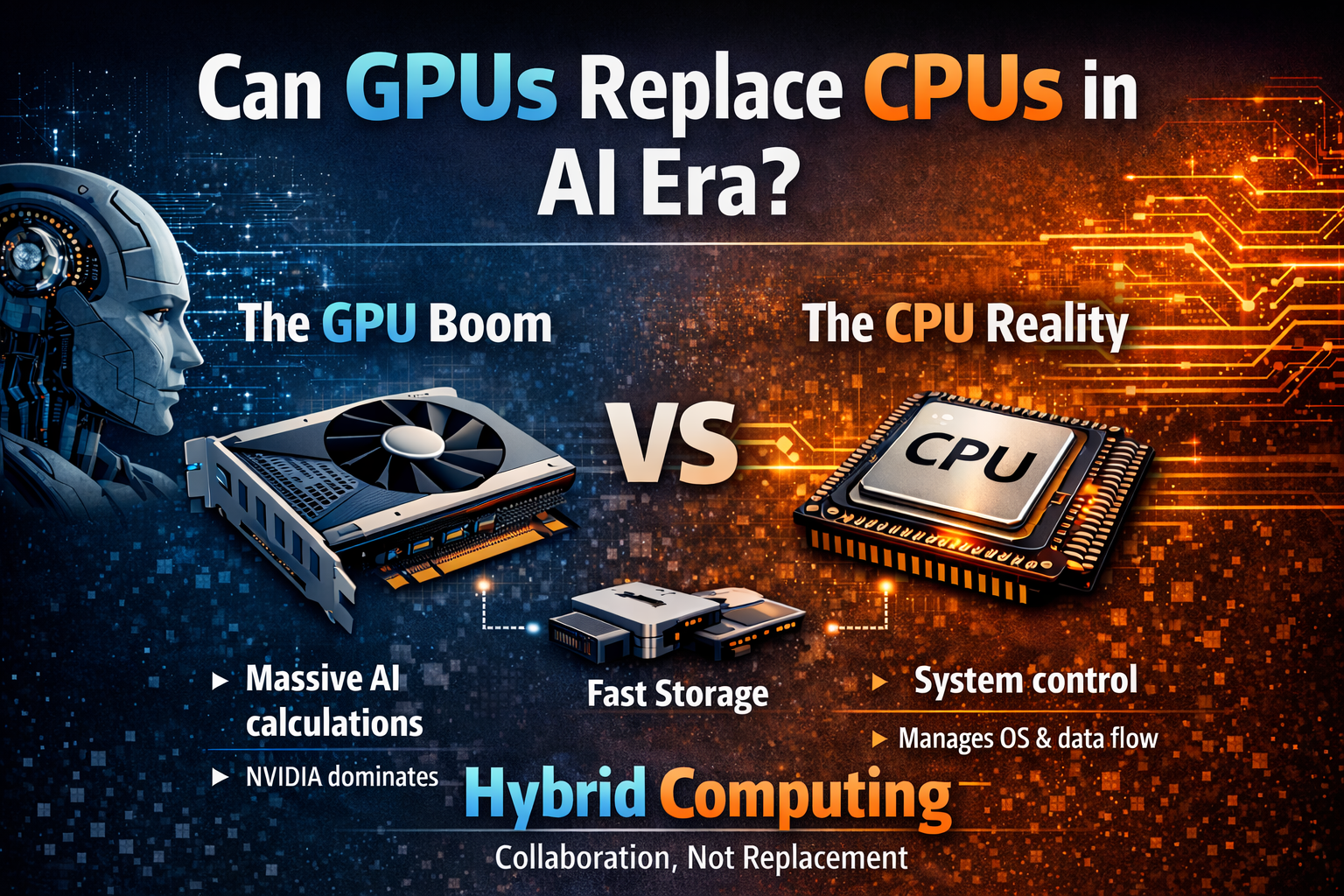

Agentic AI đang mở ra một bước ngoặt mới cho hạ tầng AI, nơi bài toán không còn chỉ là sức mạnh tính toán mà là khả năng điều phối hệ thống phức tạp theo thời gian thực. Trong bối cảnh đó, CPU đang dần quay trở lại trung tâm, không phải để thay thế GPU, mà để trở thành lớp kiểm soát quyết định hiệu năng và kiến trúc của toàn bộ hệ thống AI.

Trong nhiều năm, câu chuyện về hạ tầng AI dường như rất rõ ràng: GPU dẫn dắt hiệu năng, còn CPU đóng vai trò hỗ trợ. Tuy nhiên, trật tự đó đang bắt đầu rạn nứt.

Đầu năm 2026, một loạt động thái đáng chú ý đã xuất hiện. NVIDIA bắt đầu cung cấp CPU Vera như một sản phẩm độc lập, trong khi Arm Holdings lần đầu tiên tung ra CPU mang thương hiệu riêng sau nhiều thập kỷ chỉ tập trung vào mô hình cấp phép.

Hai công ty với chiến lược hoàn toàn khác nhau nhưng lại cùng bước vào một thị trường tại cùng một thời điểm. Đây không phải là sự trùng hợp. Đó là tín hiệu cho một thay đổi mang tính cấu trúc trong cách thiết kế Data Center cho AI.

Từ “GPU thống trị” đến điểm nghẽn điều phối

Trong kiến trúc Data Center truyền thống, CPU là trung tâm điều khiển. Nó xử lý logic, các tác vụ tuần tự và vận hành hệ thống tổng thể. Sự bùng nổ của deep learning đã thay đổi hoàn toàn điều đó. Các phép toán ma trận quy mô lớn khiến GPU trở thành lựa chọn tối ưu nhờ khả năng xử lý song song. CPU dần bị đẩy về vai trò hỗ trợ, chủ yếu cấp dữ liệu cho GPU.

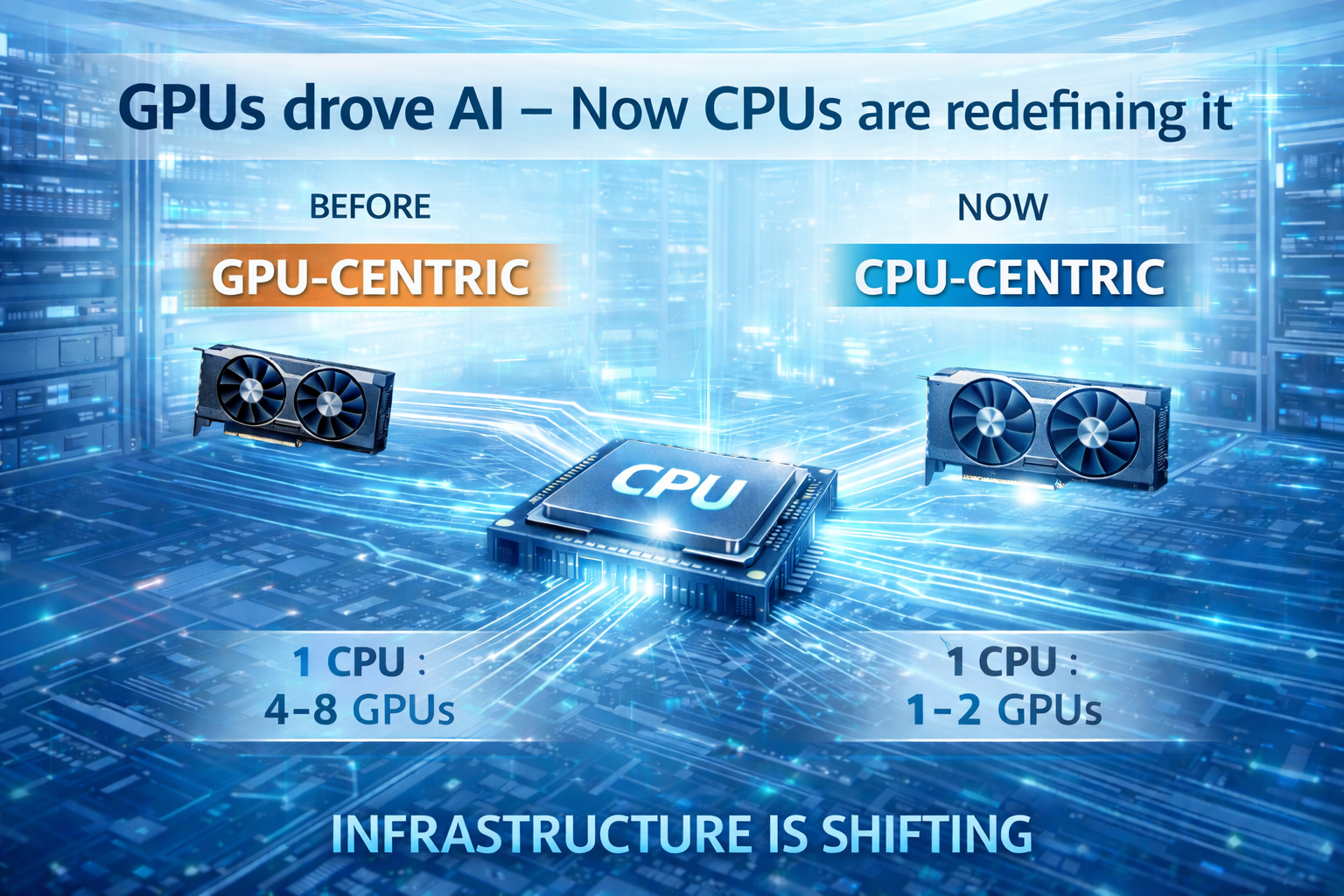

Kết quả là mô hình quen thuộc ngày nay: tỷ lệ CPU:GPU trong các cụm AI có thể ở mức 1:4, thậm chí 1:8. Mô hình này hoạt động tốt với các workload AI tĩnh. Nhưng nó bắt đầu bộc lộ hạn chế khi bước sang kỷ nguyên agentic AI.

Agentic AI: Khi điểm nghẽn quay trở lại CPU

Agentic AI mang đến một cách vận hành hoàn toàn khác. Thay vì chỉ tạo ra đầu ra, hệ thống AI giờ đây có thể:

- Lập kế hoạch nhiều bước

- Gọi các công cụ bên ngoài

- Phối hợp nhiều agent

- Đánh giá kết quả trung gian

- Lặp lại để đạt mục tiêu

Lớp xử lý này không nằm trong thế mạnh của GPU. Đây là bài toán điều phối hệ thống và đó chính là lĩnh vực của CPU. Mỗi lần gọi tool, mỗi quyết định routing hay mỗi vòng lặp kiểm tra đều làm tăng tải cho CPU. Khi kết hợp với reinforcement learning, áp lực này còn lớn hơn do mỗi hành động cần được đánh giá và phản hồi liên tục.

Thực tế, nhiều nghiên cứu đã chỉ ra:

- Độ trễ của hệ thống agent có thể bị chi phối bởi xử lý phía CPU

- Throughput không chỉ phụ thuộc GPU mà còn phụ thuộc kiến trúc CPU và khả năng đồng bộ

- Mức tiêu thụ điện phía CPU đang chiếm tỷ trọng ngày càng lớn

Nói cách khác, điểm nghẽn đang dịch chuyển.

Tái cân bằng hạ tầng: CPU đang quay trở lại

Khi orchestration trở thành yếu tố trung tâm, cấu trúc hạ tầng truyền thống bắt đầu thay đổi.

Các ước tính cho thấy Data Center AI có thể cần nhiều hơn tới 4 lần số core CPU trên mỗi đơn vị năng lực tính toán so với trước đây. Tỷ lệ CPU:GPU vì thế sẽ dịch chuyển từ 1:8 về gần 1:1 hoặc 1:2. Đây không phải là một điều chỉnh nhỏ. Đó là sự tái cân bằng toàn bộ stack hạ tầng. Và khi nhu cầu thay đổi nhanh như vậy, nguồn cung hiếm khi bắt kịp ngay lập tức.

Áp lực mới: Nhu cầu CPU tăng và thị trường nóng lên

Sự thay đổi này đã bắt đầu phản ánh vào thị trường. Nhu cầu CPU đang tăng mạnh, không chỉ trong các hệ thống AI mà còn ở hạ tầng doanh nghiệp nói chung. Các hãng như Intel và AMD đã bắt đầu điều chỉnh giá ở một số dòng sản phẩm. Nhưng giá chỉ là bề nổi. Thay đổi lớn hơn nằm ở cạnh tranh.

Thị trường CPU không còn là cuộc chơi của hai người

Trong nhiều năm, thị trường CPU server gần như là cuộc cạnh tranh giữa Intel và AMD. Điều đó đang thay đổi nhanh chóng. Hiện nay:

- NVIDIA đang mở rộng theo hướng tích hợp dọc

- Arm dịch chuyển xuống thị trường sản phẩm hoàn chỉnh

- Các hyperscaler tự phát triển chip riêng

Đây không chỉ là cạnh tranh. Đây là sự phân mảnh của toàn bộ chuỗi giá trị.

CPU trở thành lớp kiểm soát chiến lược

Một xu hướng rõ ràng đang hình thành: kiểm soát CPU đồng nghĩa với kiểm soát hệ thống. Các hyperscaler như Amazon Web Services, Google và Microsoft đang đầu tư mạnh vào CPU tự thiết kế, kết hợp với các accelerator riêng. Lý do rất rõ:

- Tối ưu hiệu năng theo workload

- Giảm phụ thuộc vào vendor

- Tối ưu chi phí ở quy mô lớn

Trong kỷ nguyên AI, CPU không chỉ là phần cứng. Nó là lớp điều phối và kiểm soát toàn bộ hệ thống.

Tác động lan tỏa đến toàn hệ sinh thái

Sự dịch chuyển này không chỉ ảnh hưởng đến các nhà sản xuất CPU. Các công ty thiết kế ASIC, dịch vụ thiết kế chip và cả chuỗi backend sẽ được hưởng lợi khi ngày càng nhiều doanh nghiệp tham gia vào cuộc chơi custom silicon. Điểm nghẽn mới có thể không còn ở GPU, mà nằm ở năng lực thiết kế và tích hợp hệ thống.

Không phải chu kỳ, mà là thay đổi cấu trúc

Rất dễ để nhìn nhận đây như một chu kỳ phần cứng mới. Nhưng thực tế không phải vậy. Agentic AI đang thay đổi cách hệ thống tính toán vận hành:

- Từ inference tĩnh sang workflow động

- Từ mô hình đơn lẻ sang đa agent

- Từ compute-centric sang orchestration-centric

Sự thay đổi này buộc toàn bộ hạ tầng phải thích nghi.

Trong vài năm qua, GPU là trung tâm của mọi cuộc thảo luận về AI. Giai đoạn tiếp theo sẽ cân bằng hơn. Không phải vì GPU kém quan trọng đi, mà vì CPU đang trở nên quan trọng hơn rất nhiều. Khi “thành phần hỗ trợ” trở thành yếu tố quyết định hiệu năng hệ thống, toàn bộ ngành công nghiệp sẽ phải điều chỉnh lại cách tiếp cận hạ tầng AI.

Chia sẻ bài viết

Bình luận

( 0 bình luận )Bình luận của bạn

Tin tức liên quan

-bad8050b4ef4b.png)