Vượt ra ngoài HBM: Samsung và SK hynix đang tìm hướng bộ nhớ AI mới

Hiện nay, hệ sinh thái tính toán AI chủ yếu dựa vào GPU của NVIDIA kết hợp với bộ nhớ HBM, trong đó SK hynix là nhà cung cấp lớn nhất. Tuy nhiên, khi các mô hình AI ngày càng lớn, ngành công nghiệp bắt đầu nhận ra rằng vấn đề không chỉ nằm ở sức mạnh tính toán, mà còn ở tốc độ di chuyển dữ liệu giữa bộ nhớ và chip xử lý.

Theo Global Economic News của Hàn Quốc, trong các workload AI phức tạp, hơn 80% thời gian và năng lượng có thể bị tiêu tốn chỉ để truyền dữ liệu. Vì vậy, nhiều công ty bán dẫn đang nghiên cứu các công nghệ bộ nhớ mới nhằm giảm “tắc nghẽn dữ liệu” trong hệ thống AI. Dưới đây là một số hướng công nghệ đáng chú ý.

PIM: Đưa khả năng tính toán vào trong bộ nhớ

PIM (Processing in Memory) là công nghệ tích hợp các đơn vị tính toán ngay bên trong chip bộ nhớ. Thay vì phải gửi dữ liệu từ bộ nhớ sang GPU để xử lý, bộ nhớ có thể tự thực hiện một số phép tính quan trọng như phép nhân ma trận, vốn là nền tảng của AI.

Sau khi tính toán xong, bộ nhớ chỉ cần gửi kết quả về GPU. Nhờ vậy, lượng dữ liệu phải di chuyển giảm mạnh và hiệu quả năng lượng có thể tăng lên hàng chục lần so với kiến trúc truyền thống. SK hynix đã phát triển một bộ gia tốc dựa trên công nghệ này có tên AiM (Accelerator in Memory) và đã thử nghiệm trong một số ứng dụng thực tế.

CXL: Chia sẻ bộ nhớ trong toàn bộ trung tâm dữ liệu

Một hạn chế lớn của máy chủ AI hiện nay là dung lượng bộ nhớ gắn trực tiếp với GPU khá giới hạn. Khi huấn luyện các mô hình AI lớn, lượng bộ nhớ này nhanh chóng trở nên không đủ.

CXL (Compute Express Link) được phát triển để giải quyết vấn đề đó. Công nghệ này cho phép nhiều máy chủ chia sẻ bộ nhớ với nhau giống như chia sẻ tài nguyên trong mạng. Nhờ vậy, hệ thống có thể mở rộng dung lượng bộ nhớ linh hoạt hơn và giảm chi phí khi huấn luyện các mô hình AI rất lớn.

Samsung hiện đã phát triển DRAM chuẩn CXL 2.0 và đang đầu tư mạnh để thương mại hóa CXL 3.0.

MRAM: Bộ nhớ nhanh nhưng tiết kiệm điện

MRAM (Magnetoresistive RAM) là một loại bộ nhớ thế hệ mới có khả năng lưu dữ liệu bằng trạng thái từ tính thay vì điện tích. Điều này giúp dữ liệu vẫn được giữ nguyên ngay cả khi mất điện, giống như ổ lưu trữ, nhưng tốc độ có thể gần tương đương DRAM.

Một ưu điểm lớn của MRAM là tiêu thụ điện năng rất thấp, điều rất quan trọng trong các hệ thống AI quy mô lớn.

ReRAM: Bộ nhớ mật độ rất cao

ReRAM (Resistive RAM) lưu trữ dữ liệu bằng cách thay đổi điện trở trong vật liệu. Nhờ cấu trúc đơn giản, công nghệ này có thể xếp chồng nhiều lớp bộ nhớ lên nhau, tạo ra mật độ lưu trữ rất cao.

Ngoài ra, cách hoạt động của ReRAM khá giống với mạng nơ-ron sinh học, vì vậy nó cũng được xem là nền tảng tiềm năng cho các hệ thống AI tiết kiệm năng lượng trong tương lai.

Samsung và SK hynix hiện đều đang nắm giữ nhiều bằng sáng chế và nguyên mẫu liên quan đến MRAM và ReRAM.

SoIC: Tích hợp chip 3D để giảm khoảng cách dữ liệu

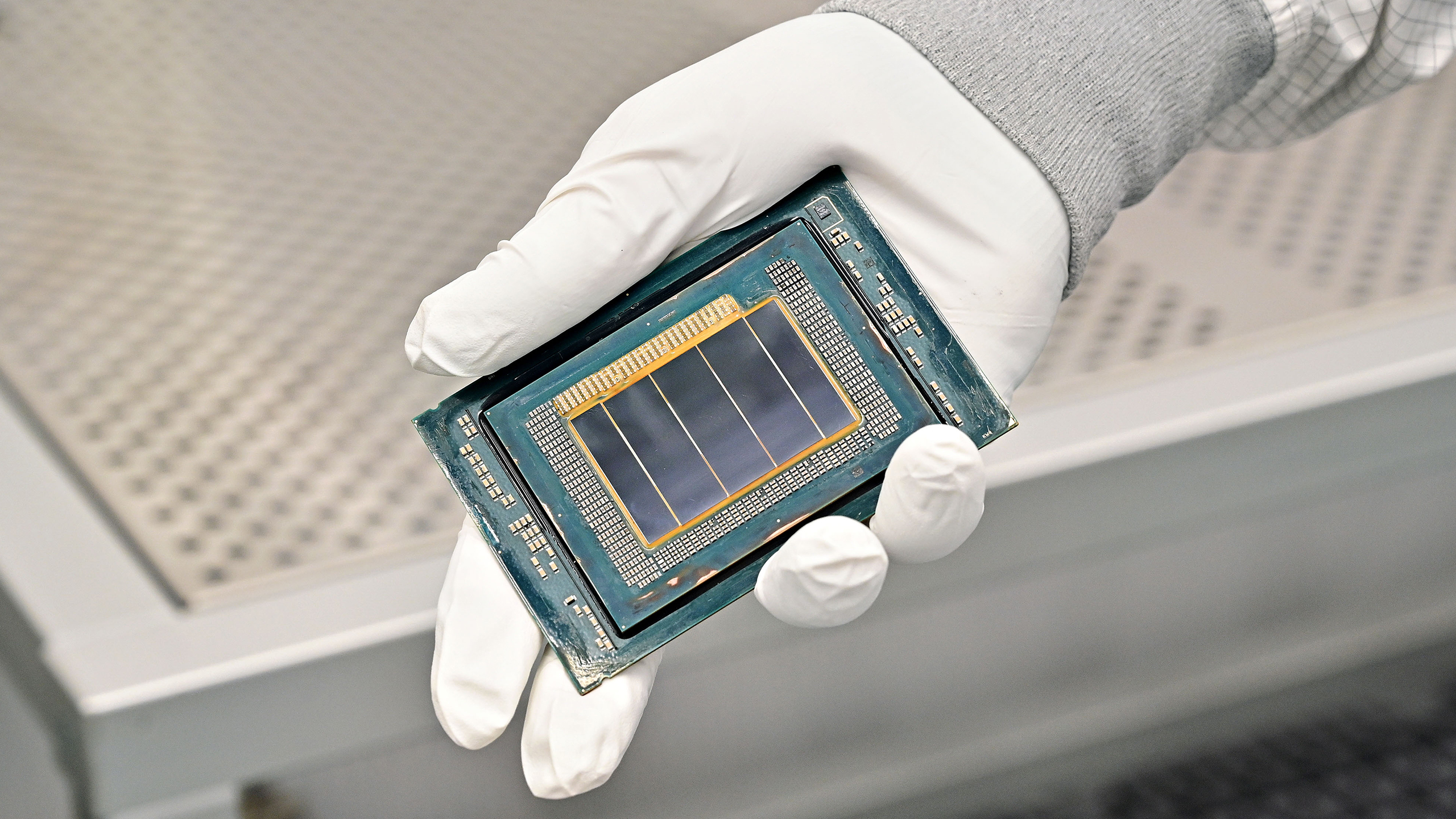

Một hướng khác không phải là tạo ra loại bộ nhớ mới, mà là thay đổi cách kết nối chip. SoIC (System on Integrated Chips) là công nghệ do NVIDIA và TSMC cùng phát triển.

Thay vì đặt bộ nhớ và chip xử lý cạnh nhau trên bo mạch, SoIC xếp chồng chúng theo chiều dọc như một khối chip duy nhất. Điều này giúp rút ngắn khoảng cách truyền dữ liệu hàng trăm lần, đồng thời cải thiện hiệu quả tản nhiệt.

HBM hiện vẫn là công nghệ bộ nhớ quan trọng nhất trong hệ thống AI. Tuy nhiên, khi các mô hình AI tiếp tục mở rộng, ngành bán dẫn đang tìm nhiều hướng mới để giảm tắc nghẽn dữ liệu và tăng hiệu quả năng lượng.

Các công nghệ như PIM, CXL, MRAM, ReRAM hay SoIC có thể đóng vai trò quan trọng trong thế hệ hạ tầng AI tiếp theo. Nếu những hướng này được thương mại hóa thành công, cấu trúc phần cứng cho AI trong tương lai có thể thay đổi đáng kể so với hiện nay.

Chia sẻ bài viết

Bình luận

( 0 bình luận )Bình luận của bạn

Tin tức liên quan